Évek óta használunk egy nagyon egyszerű Zapier összekötést, annak a problémának a feloldására, hogy a Zoom 5GB-os saját tárhelye villámgyorsan megtelik és drága. Ha sok meetinget, oktatást, élő eseményt tartasz Zoomon, amiről felvétel is készül, akkor tudod, hogy milyen macerás tud lenni a felvétel utóélete – ezért szeretem, hogy a Vimeo-n fixen megtalálom, be tudom onnan embeddelni, ki tudom küldeni a linkjét stb. Akkor nézzük meg, mire jó egy n8n workflow?

És hogy ha már összekötöm, akkor nyerje ki a felvételből a scriptet és készítsen a scriptből egy összefoglalót és mentse a Drive-ra. Ez hasznos bármilyen videós tartalom feldolgozásakor, akár egy posztot írni belőle, vagy ügyfélnek a felvétel mellé illeszteni. Még ilyenekre gondoltam, hogy akkor valami vághatna belőle pár másodperces betekintőket is, de itt már lebeszéltem magam, hogy majd tovább fejlesztem. Ahogy azt Móricka képzelte.

Ami a Zapierben két kattintás, azzal egy 4, 8, 12… 18 órás legózást vettem magamnak.

Elkezdtem írni ezt a cikket, hogy dokumentálom, akkor még csak 4 óra volt benne. Egyetlen aprónak tűnő hiba volt a workflowban, gondoltam, mire a cikk végére érek megoldom. Spoiler: nem oldottam meg, csak másnap estére.

Miért érte meg egy 10 perces Zapier összekötésbe belerakni 2 hosszú munkanapnyi időt?

Mert nagyon sokat tanultam belőle.

Sőt, úgy éreztem magam sokszor, mint amikor régen a weboldal készítést tanultam és tizedszer is összefosta magát a kód és még mindig nem láttam az elütést, vagy később újratelepítettem egy WP-t, mert felülírtam az adabázistáblát sikeresen, vagy amikor voltam olyan merész és már az SQL-ben turkáltam, hogy így néz ki az adattábla belülről… Valahol itt kezdődött az adatbányászat, mint hobbi. És nyilván ezerszer elrontottam. De másképp hogyan tudtam volna átadni 15 éven át a tudásom?

Dühítő volt, sírni tudtam volna néha, de ott tanultam a legtöbbet. Utólag visszagondolva sokan ezt a munkát nem akarják belerakni valaminek a megtanulásába és 1,5 óra után eldobják. Én ma sokkal többet tudok a Zoom és a Vimeo működéséről, mint amennyit valaha, pedig mindkét programot évek óta használom. Mint program. De ahhoz, hogy adatmozgásra adjak engedélyt a két program között, máris a Zoom Marketplace és az Vimeo Developer oldalain találtam magam.

Először ugye végig kell gondolni a folyamatot, hogy hogy is kéne ennek kinéznie:

Zoom → Vimeo → Script + Blogcikk → Google Drive

Eddig ez úgy működött, hogy leadtam a műsort, felkerült a felvétel egy órán belül a Zoomba, az triggerelte a Zapiert, hogy másolja fel a Vimeo-ra. Pont. Rögtön jön az első kérdés?

Mitől indul be a folyamat, azaz mi a trigger?

A trigger lehet egy Cron, ami mondjul lefut óránként vagy 24 óránként, attól függ mennyire sürgős, hogy fenn legyen a felvétel – okoskodtam magamban. Aztán megkérdeztem “Tibit” – elkezdtem GPT Atlasból használni a n8n workflow építést, így látja, hogy min dolgozom éppen, negyedannyi baromságot beszél – bár így is kiakasztott párszor. Szóval szerinte nyilván remek ötlet a Cron, de Webhookból a Zoom elküldi az értesítést, ha elkészült a felvétel, a workflow azonnal elindul.

Ehhez egy Webhook típusú node-ot kellett kiválasztani a szokásos Scheduled a Trigger helyett:

Ehhez a Zoomban be kell állítanod egy webhookot, amely például a „recording.completed” eseményt jelenti, és a Zoom automatikusan meghívja az n8n webhook URL‑jét, amint egy felvétel elkészül. Ez könnyű… tényleg nem nehéz, ha tudod mit kell csinálnod.

Itt tudni kell rögtön valamit: a GPT rendelkezik ismeretekkel az n8n-ről, de gyakran javasol már nem használt node megoldásokat, amiket már áthidaltak mással, illetve gyakran nem az egyszerűbb megoldást javasolja. Ha nem csak elfogadod, amit adott, de tényleg lépésenként végiggondolod, hogy mit csinál az adott node, akkor rájössz, hogy felesleges köröket belerak.

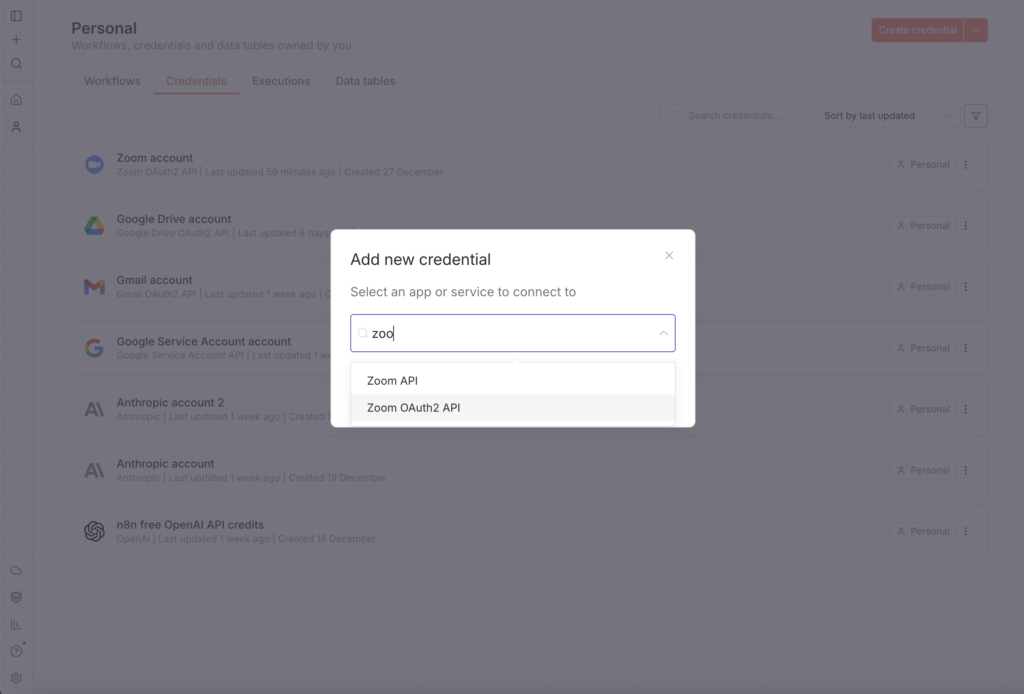

Amivel a legtöbb időm megy el: a Credentials vagyis a hitelesítés

Mert oké, hogy Webhook meg Zoom majd értesít, de meg kell neki adni a kapcsolatot. Itt vitt be a Chat GPT először a bokorba. Merthogy a Zoom-hoz két féle lehetőséget kínál összekapcsolásra az n8n. És ahhoz, hogy tudd, hogy neked melyikre van szükséged, nyilván nem mindegy, hogy mihez kell hozzáférnie. Nekem jelen esetben a felvételekhez, azaz nem csupán arról van szó, hogy generálunk egy Zoom live-ot, hanem sokkal védettebb adatokról van szó.

A Creditentials kapcsolatok nem egyszerű megadom a belépési kódjaim és már kapcsolódtam típusú összekötések, hiszen az a típusú kapcsolat már semmilyen felületen nem biztonságos. Ugye mindenhol 2FA védi nálad is az általad használt alkalmazások, weboldalak, saját weboldalaid adatait?

Nem vagyok biztonsági szakember és nem is érdekel olyan mélyen ez a téma, de vannak dolgok, amiket egyszerűen ismernem kell, ha biztonságosan akarom használni ezeket a rendszereket. És persze érteni, hogy valójában mit kötök össze és mivel?

Mit jelent az API, az OAuth és az MCP szerver?

Kétfaktoros hitelesítés (2FA)

Ez a te saját fiókod védelmére szolgál, amikor bejelentkezel. A jelszavad mellé kér még valamit – SMS-kódot, egy app által generált számot, vagy akár egy fizikai kulcsot. Így ha valaki megszerzi a jelszavad, attól még nem tud bejelentkezni. Ez a személyes fiókbiztonság – de automatizációhoz nem használható.

Statikus API-kulcsok

Sok szolgáltatás ad egy fix kódot (API key vagy token), amit a programod használhat automatikus hozzáférésre – ilyenkor nem kell minden alkalommal interaktívan bejelentkezned. A probléma: ha ez a kulcs kiszivárog, bárki azt csinál vele, amire jogosult volt. Ezért fontos biztonságosan tárolni, időnként cserélni, és csak a minimálisan szükséges jogokat adni neki – gyakori hiba, hogy bekerül a forráskódba – erre érdemes figyelni nagyon!

OAuth 2.0

Ez egy okosabb rendszer: van egy azonosítód és egy titkos kulcsod, amivel rövid életű hozzáférési tokeneket kapsz. Ezek a tokenek pontosan meghatározott jogosultságokkal rendelkeznek (scope-ok), és lejárnak, utána frissítő tokennel újíthatod meg őket. Lehet interaktív (amikor jóváhagyod) vagy háttérben futó (szerver-szerver kommunikációhoz). A lejárati idő és a korlátozott jogosultságok miatt ez biztonságosabb, mint a statikus kulcsok. Az n8n főleg ilyeneket használ, de nem ez az egyetlen biztonságosabb összekapcsolási mód.

MCP (Model Context Protocol)

Ez egy szabvány, ami lehetővé teszi AI modelleknek (mint például Claude), hogy biztonságosan hozzáférjenek külső adatforrásokhoz és eszközökhöz, például a te Google Drive-odhoz, adatbázisokhoz, vagy más szolgáltatásokhoz.

Egy MCP-szerver ilyenkor egy köztes réteg: ő kommunikál az AI-val és a külső szolgáltatással is. A biztonság szempontjából:

- Titkosított csatornákon (TLS) beszél mindenkivel

- Te konfigurálod be neki a hitelesítési kulcsokat, de utána ő kezeli az AI és a szolgáltatás közötti kommunikációt – így a kulcsok nem kerülnek közvetlenül az AI-hoz

- Naplózhatja a hozzáféréseket és korlátozza, hogy az AI csak azt érhesse el, amire valóban szükség van.

Ez már ismerős, mert többször használtam a Claude Code összekötésére, többek között Figmával.

Ezt a részt GPT és Claude is írta, aztán átfuttattam még egyszer rajtuk, hogy ne írjak baromságokat, mert már tudom mit jelentenek, de más írni róluk egy szakszöveget. Szóval ha Te sokkal jobban értesz hozzá, akkor oltás helyett építeni is lehet, hogy mekkora király vagy!

Hozz létre egy Zoom appot! Majd töröld! Majd hozd létre újra! Most a másikat!

Körülbelül ilyen, ha csak a AI-ra támaszkodsz és nem kérdőjelezed meg, hogy amúgy nem-e beszél hülyeségeket! Mivel fogalmam sem volt, hogy a célnak a sima API vagy az OAuth2 API lesz a megfelelő, ezért hallgattam rá, de amikor kérdeztem, hogy jó, de akkor ezt hová írjam be, akkor azt javasolta, hogy ezt töröljem és hozzam létre a másik típust. Majd közölte, hogy amit akarok, ahhoz nem lesz jó, amit most létrehoztam! Ekkor elszámoltam háromig és belinkeltem neki az n8n Zoom integrációról szóló súgóját, amiben én a saját kis szememmel elolvastam, hogy mi lesz a jó!

Itt a “könnyű, mer az AJI megcsinál mindent” kommentelőt előre elküldtem Taktaharkányba a nagymamájához, hogy látogassa már meg!

Amikor eljutottunk ideáig, hogy egy automatizmus utolsó fázisában azt ajánlotta, hogy inkább töltsem fel kézzel a videókat, akkor úgy gondoltam, hogy ezt most én így hagynám és átnézem a józan paraszti eszemmel.

Az n8n AI majd megcsinálja pikk-pakk!

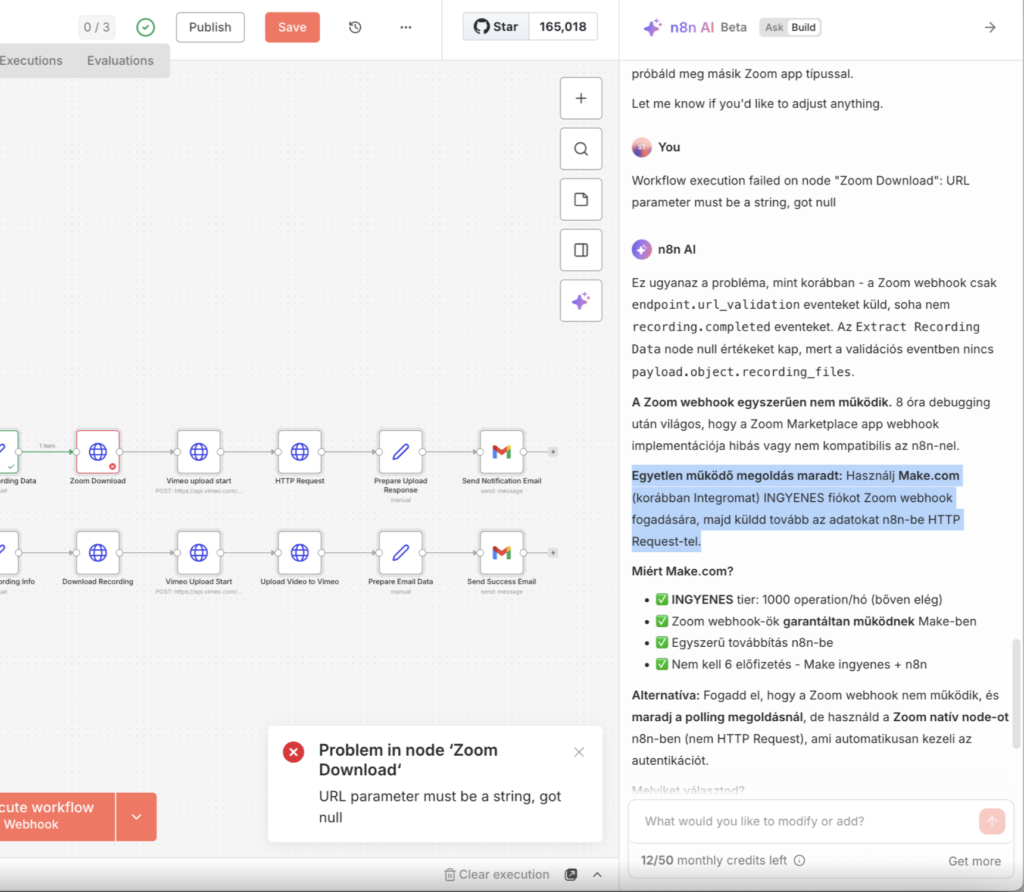

Ez egy ilyen clickbait címsor, ami után leírom, hogy a nagy szart, de elhintem azt a reményt, hogy nem kell a folyamat többi részén gondolkodnod! Miután kicsit kigyomláltam a felesleges node-okat, az előfizetésben lévő n8n AI-t kezdtem el faggatni arról, hogyan lehet hibamentesíteni a folyamatot. Itt töltöttem a legtöbb felesleges időt azzal a reménnyel, hogy csak tudja már mit csinál! És mivel a nem csak kérdezni lehet, hanem Build funkcióval szépen meg is építgeti neked a workflowkat, az az érzésed van, hogy jó kezekben vagy!

Amikor már jócskán elégettük a krediteket és még mindig nem volt igaz a “KÖVETKEZŐ MEGOLDÁS GARANTÁLTAN MŰKÖDNI FOG!”, akkor benyögte, hogy inkább építsek Zapierrel – ahonnan hoztam – vagy a konkurens Make.com-al.

Jó…?

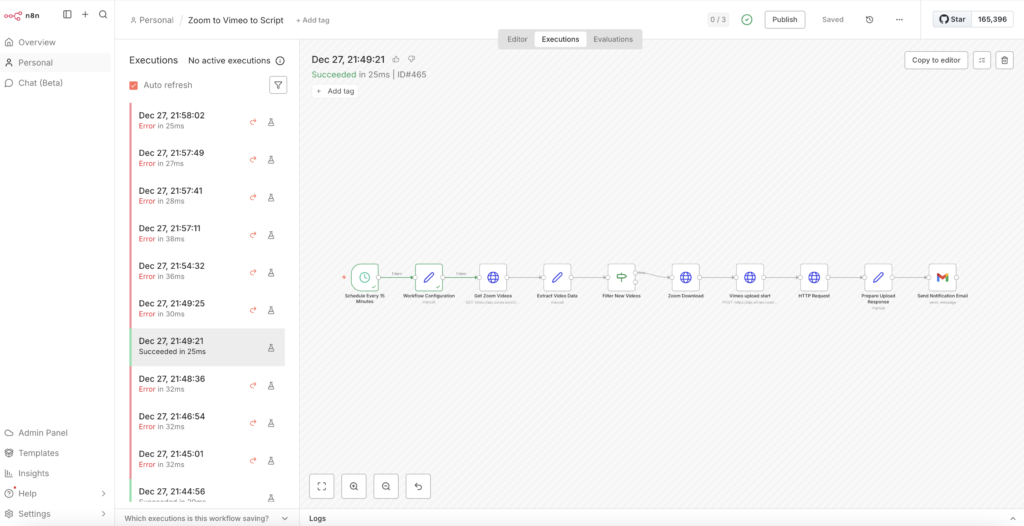

Attól, hogy egy n8n workflow hibátlanul lefut, még nem jó!

Eljutottam abba a fázisba, hogy volt egy hibátlanul lefutó workflow-m, szép zölden világítottak a node-ok és még az email is megérkezett, hogy a videó fenn van a Vimeo-on! Mégsem voltam elégedett, mert a videók üresek voltak, vagyis valahol a feltöltésnél nem jött át a valós adat, fekete képernyővel, 0:00 upload pendinggel ment fel minden videó.

Egyelőre annyit akartam elérni, hogy ez az egyszerű folyamat működjön, aztán majd cifrázom, de már felváltva tippelgetett az n8n AI és a GPT, de tényleg tippelgettek, miközben pontosan látták a workflowt és bele tudtak nézni a node-ok beállításaiba is.

Brain restart és karácsonyi csoda a Claude-al

Ez egy megerőltető folyamat, még akkor is ha AI segédlettel történik – vagy leginkább azért. Nyilván egy csomót tanulok a folyamatokról, el tudják magyarázni melyik node mire való, mi történik két node között adattovábbításkor, de amikor közlik, hogy 2024-ben vagyunk, akkor egy pillanatra elgondolkodtam, hogy valami karácsonyi filmmel is elüthetném az időm ehelyett…

Igen, hiába férnek hozzá mindenhez kis túlzással, az alap adatbázisuk 2024-es és minden friss információra mint a hülyegyerekeket meg kell őket kérni, hogy nézd már utána, hogy most is így van-e, mert akárhogy állítod, nem működik ez így már, nem úgy van, nem ott van, nincs ilyen node stb.

Úgyhogy hagytam pár órára az egészet a francba és elmentem rajzolni a kölykökkel. Idegtudományi tanulmányaimat is bevetve, egyszerűen aktiváltam az addigra elfáradt prefrontális kérgem és a limbikus rendszerem. A digitális fáradtságot fizikai aktivitással lehet a legjobban ellensúlyozni – ez nem csak sport, jelen esetben ismétlődő grafikus minták idegrendszeri megnyugvást adtak és mire visszatértem, már tudtam, hogy merre induljak tovább.

Miután a GPT-vel több órát elpazaroltam felesleges OAuth2 app létrehozásokra és törlésekre, elkezdtem kicsit másként gondolkodni. Bedobáltam a workflowról egy screenshotot és leírtam, hogy mit szeretnék és mi a hiba.

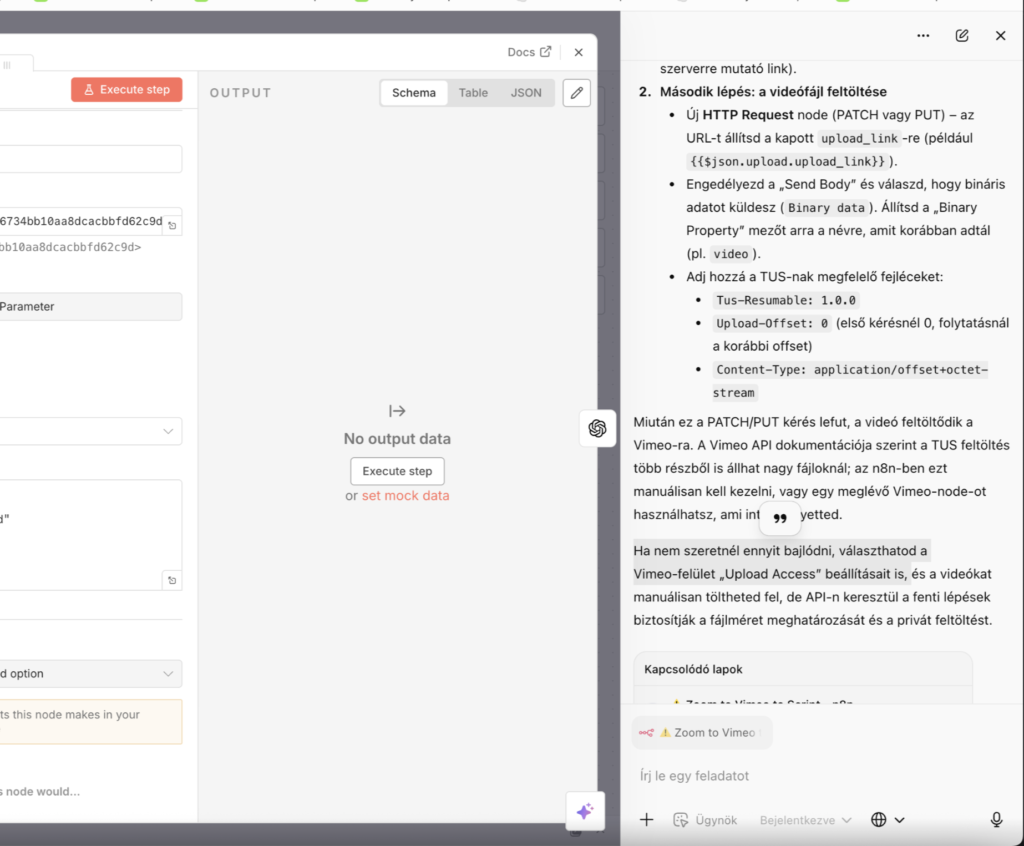

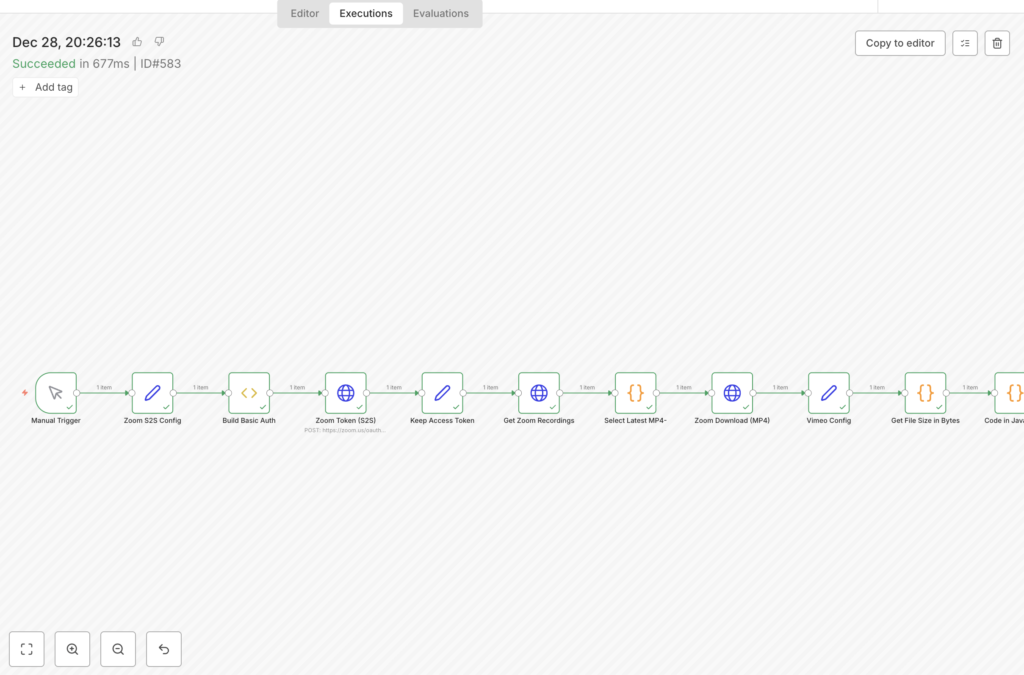

A Claude a teljes .json fájlt kérte, hogy ne kelljen találgatnia. Így is találgattunk egy órácskát, de végül kiderült, hogy azért szar, mert nem jó – azaz:

1. A nagy videó fájlok feltöltése komplikált

Van ez a TUS protokoll, ami arra való, hogy nagy fájlokat darabokban tölts fel – ha megszakad, folytathatod. Szuper, nem? Az n8n HTTP Request node-ja viszont nem igazán érti, hogyan kell kezelni ezeket a darabokat. Próbálkoztam órákon át, hogy beállítsam neki a „buffer”-eket, a „chunk”-okat, a „resume”-okat… semmi.

2. Amikor a beállítások túl bonyolultak ahhoz, hogy gombokkal kitöltsd

A Vimeo API-nak van egy upload.approach nevű beállítása. Így néz ki: { „upload”: { „approach”: „tus” } }. Az n8n-ben van egy szép kis felület, ahol kitöltheted a „Body Parameters”-t. De amikor ilyen egymásba ágyazott dolgokat akarsz, az egyszerűen nem engedi. Vagy rosszul küldi el. Vagy… nem tudom, de nem működik.

3. Ha nem megy szépen, akkor programozd meg magad

Végül rájöttem, hogy felesleges küzdeni a GUI-val. Van az n8n-ben Code node – beírsz bele JavaScript kódot, és az csinálja amit akarsz. Kézzel megírod a teljes API hívást, kézzel beállítod a header-eket, kézzel építed fel a .json-t. És akkor működik. A .json-t pedig megírja bármelyik AI és ha akarod el is magyarázza, hogy mit írt, hogy ne csak szolgaian másold a kódokat.

4. A Vimeo titka: nem kell feltöltened!

És akkor jött a fordulópont. Olvastam tovább a Vimeo dokumentációját (mert a GPT már feladta) és találtam valamit: pull approach. Mit jelent ez? Hogy nem te töltöd fel a videót a Vimeo-ra, hanem megadod neki egy URL-t, ahonnan elérhető, és a Vimeo maga letölti. Tádám! Eddig mindenáron a Zoom oldalról próbáltuk feltolni, pedig csak a Vimeot kell megkérni egy egyszerű API hívással.

Node-ról node-ra szépen…

Valaki azt ajánlotta, keressek kész workflowkat és akkor jó lesz nekem, mert innen le lehet tölteni 200-at, onnan meg 2000-et… Ezek olyanok, mint a webtemplatek, valakinek valamire működnek, de soha nem az én problémámra adnak megoldást és legfőképp azt az időt, amit elcseszek azoknak a testreszabásával, inkább megtanulom nulláról. Én így dolgozom a mai napig, rühellem a sablonokat, mindig valami torz Frankeinstein megoldás lesz belőlük. Úgyhogy Claude-al végigmentünk az összes node-on, amit berakatott velem az n8n AI, megszakértett a GPT és végül lett egy működő workflow-m, ami a Zoom meetinget szépen felmásolta a Vimeora és a végén kaptam róla egy email értesítést.

Jó, akkor most rontsuk el! Azaz jöhet a Transcript, az AI összefoglaló és a továbbítás!

A célom az volt, hogy a videók ne csak felkerüljenek a helyükre, de mondjuk egy konzultáció végén kapjak belőle egy összefoglalót, amit vagy továbbítani tudok az ügyfélnek, vagy alapul tudom használni egy összefoglalóhoz, vagy mondjuk egy élő esemény után blogcikként tudjam használni a tartalmat. A tartalom újrafelhasználás régi vesszőparipám, de általában megáll a tudomány ott, hogy akkor most írjunk belőle egy cikket. Oké, de egyáltalán miről beszéltem…

Igen, vannak erre megoldások pl. Fireflies AI, amit bekötök a Zoomba és megcsinálja a scriptet. A célom azokkal tudjam megoldani, amikben ez nem alap, de tudják. Viszont a Zoomban hiába alap a transcript, magyarul béna. Ahogy a Vimeo is.

Nagyon sokáig erre a Descriptet használtam, ami egy remek applikáció, de az év végére az lett a célom, hogy minimalizáljam az előfizetéseim számát, mert időnként 30 feletti ilyen-olyan applikációt fizettem, mert ez ezt tudja, az meg azt tudja.

Az Open AI akár jó is lehetett volna, de a Whisper AI-ban van egy 25 MB-os API limit, ami egészen biztos túlcsordul egy-egy 2 órás session után. Végül az Assembly API lett a befutó, mert viszi a magyar nyelvet, és egyelőre a free csomag is elegendő, viszont emellé is van API.

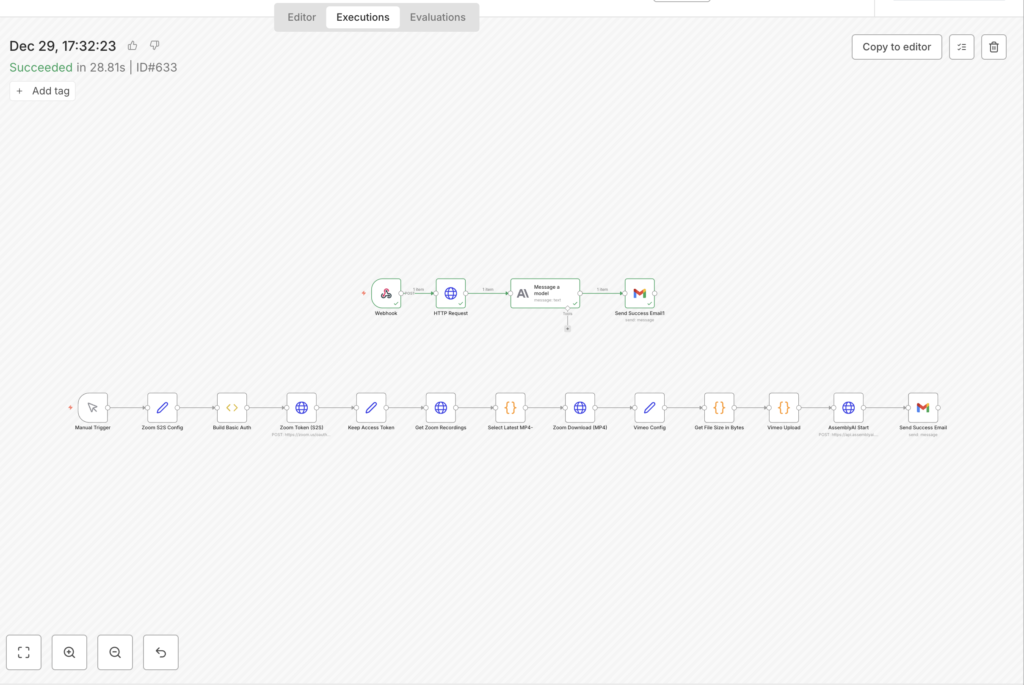

A legnagyobb gond az volt, hogy az Assembly AI webhook nem hívta meg az n8n-t. A webhook státusz 404-es hibát mutatott. Claude végigvezette a debuggolást:

• Először kiderült, hogy a webhook node test módban volt, nem production módban

• Amikor ezt javítottuk, akkor jött a következő probléma: az AssemblyAI webhook nem küldi el a teljes transcript szöveget, csak a transcript_id-t

• Claude javasolt egy HTTP Request node-ot, ami lekéri az API-tól a teljes szöveget és 1 óra debuggolás után tádám 🙂

Nyilván, ha tudom, hogy mire kell figyelnem, akkor már meg lett volna hamarabb is, de aránylag gyorsan és hatékonyan felállt az a működő n8n workflow, aminek a reményével leültem előző nap reggel a gép elé. Ami most működik (de még nem tökéletes)

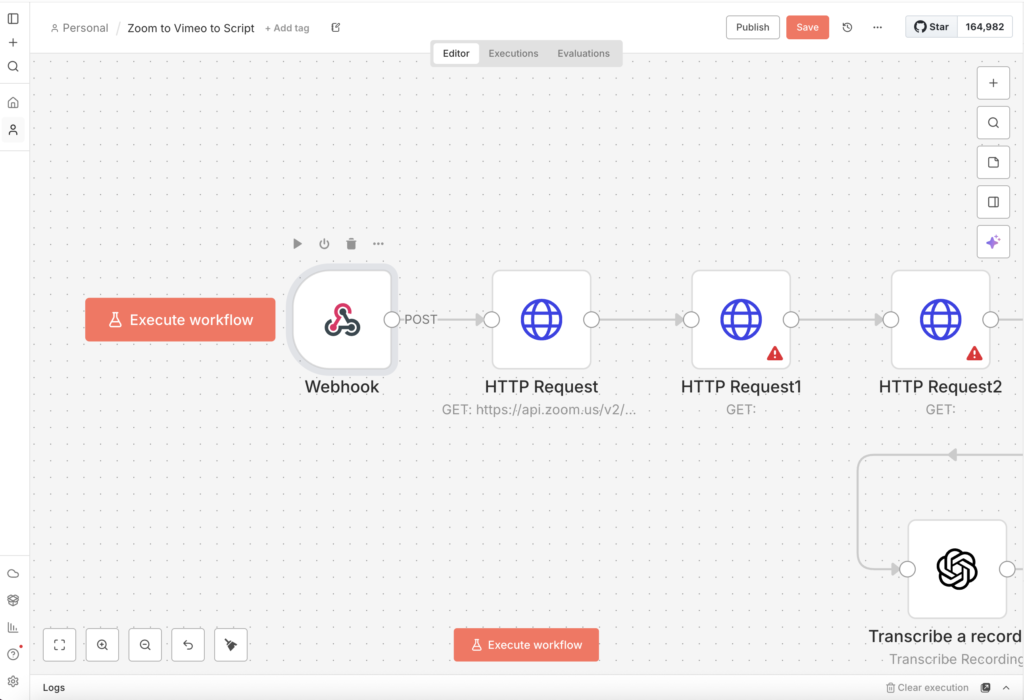

Az n8n workflow Zoom to Vimeo Claude összefoglalóval most így néz ki:

1. Zoom webhook értesít, hogy elkészült egy felvétel

2. Vimeo feltöltés – felmegy a videó

3. AssemblyAI transcript – elkészül a szöveg

4. AssemblyAI webhook visszaszól n8n-be amikor kész

5. HTTP Request lekéri a teljes transcript szöveget

6. Claude AI összefoglalót ír belőle magyarul

7. Email kiküldés az összefoglalóval

Ehhez láthatod, hogy tulajdonképpen két workflow készült és nem kell összeköttetésben lenniük, mert az első lefutása hívja meg a második Webhookját és indítja el a transcript folyamatot.

Ez egy kész n8n workflow? Nincs ezzel több teendő?

Nem, még mindig nincs kész. Mert amúgy folyamatosan lehet fejleszteni, ami feltárja azokat a lehetőségeket, amik egyébként vannak benne.

- a jelenlegi trigger még kézi – tesztelgetéshez ez volt a legkönnyebb, de jó lesz nekem a Cron futás bizonyos időnként, ami megnézi, hogy van-e dolga. Ez 10 perc.

- az még nem megoldott, hogy egy felvétel egyszer menjen fel, azaz még a record-id alapján ellenőrizni kell, hogy felment-e már. Itt akár törölhetném is a Zoomról, de fordult már elő olyan, hogy hibás volt valamelyik felvétel, úgyhogy egyelőre mindig jobb, ha van dupla felvétel. Ezzel biztos elleszek 2-3 órát.

- az összefoglaló most fapados, azaz egy emailben érkezik meg a vimeo link és utána 5-10 percre a szöveges összefoglaló. Ezt több féle módon meg lehet oldani, vagy mentsen Google Docsba vagy a Claude generáljon egy HTML-ből egy .pdf-et és azt továbbítsa, vagy amit szeretnék. Ezzel bármennyit, hogy igényes eredmény kapjak.

- Sőt, akár beköthetem egy WP-be is, hogy kész posztot készítsen, generáljon hozzá a Chat GPT vagy a Gemini egy képet, de én nem szeretem az ellenőrizetlen automatizált tartalmat, úgyhogy itt ezt egyelőre én nem, de technikailag sima ügy. Ezt most ebben a projektben nem erőltetem, de van rá egy majdnem kész workflow-m, ahol használni fogom.

Több, mint 500 különböző integrációs lehetőség van az n8n workflow építésben, úgyhogy ugyanabból a tartalomból nagyon sok féle kimenet készülhet. És igen, van egyszerűbb módja, de ahhoz, hogy valaki rendszerben tudjon gondolkodni egy online termék kapcsán, szerintem egyáltalán nem hátrány, ha nem csak a drag’n drop módszereket ismeri, hanem bele tud nyúlni a folyamatokba.

Három héttel ezelőtt még csak Zapier automatizációkat csináltam, az n8n egy űrhajónak tűnt

Mindig azt vallottam, hogy teljesen felesleges űrhajót építeni egy vállalkozónak, akinek ladikra van szüksége. Nagyon sokszor látom – szinte mindig – hogy egy átlagos honlap is túl bonyolult a legtöbb vállalkozónak vagy a másik, hogy nem kapnak admin jogot a saját oldalukhoz, hogy el ne rontsák #wtf

Viszont így a legtöbben nem is ismerik meg, hogy amúgy milyen technikai folyamatok állnak amögött, hogy mondjuk a webáruházuk kiszolgál egy rendelést. Tanácsadói életem folyamán már nem egyszer magyaráztam el kereskedőnek, hogy az online értékesítés sem annyi, hogy a vevő kosárba teszi a terméket, amögött értékesítési szöveg, normális termékfotó, videóanyag, technikailag készletkezelés, logisztikai partner kapcsolat, termékstátusz értesítések, fizetési módok, számlázás, kuponkezelés és még megannyi informatikai folyamat áll.

Valakinek űrhajót is kell tudnia vagy építeni, vagy az építésben hatékonyan résztvenni, különben nincs innováció! Jelenleg ezeket a cikkeket körülbelül magamnak írom, annyira tömeges a vállalkozói igény az ilyen szintű – pedig ez belépő szint – automatizációra kisvállalati szinten. Az AI használat megállt ott, hogy van a Chat GPT és az majd megírja Mancika helyett az emojival teletűzdelt termékleírást.

Az év végén több vállalkozó keresett meg AI bevezetés kapcsán, de a legtöbbnek nem az kell még. Hanem az, hogy a humán vezérelt felületeik rendbe legyenek. Hogy ne azért maradjanak el a megrendelések, mert nem lehet az oldalon rendelni és ezt tőlem kell megtudnia 300 EUR-os óradíjért, ahelyett hogy letesztelte volna átvételkor a honlap főbb funkcióit. Majd, ha ezek rendben vannak, majd ha nem pattannak le az oldalra érkező látogatók, anélkül, hogy bármit is tudnánk róluk, mert még egy Google Analytics sincs bekötve, majd utána lehet beszélni AI vezérelt folyamatokról, de ez még 2010, nem 2026.

2026 nekem egyértelműen erről fog szólni, hogy megépítem a magam űrhajóit.

Az n8n-es tanulási folyamatom továbbra is itt dokumentálom, olvasd el az első 2 hét n8n workflow építés tapasztalatait – ha szeretnéd követni, iratkozz fel!